Jól beszabályozzák az AI-t és ezt te is rendesen meg fogod érezni

Ha minden igaz, akkor az újonnan elfogadott rendelet értelmében egy csomó személyiségi jogot védenek meg az AI-tól és rájár a rúd a generált tartalmakra is.

Ha minden igaz, akkor az újonnan elfogadott rendelet értelmében egy csomó személyiségi jogot védenek meg az AI-tól és rájár a rúd a generált tartalmakra is.

Ha minden igaz, akkor az újonnan elfogadott rendelet értelmében egy csomó személyiségi jogot védenek meg az AI-tól és rájár a rúd a generált tartalmakra is.

2024.03.16. – Az Európai Parlament március 13-án elfogadta a mesterséges intelligencia szabályzásáról szóló uniós rendeletet. Ennek értelmében – ha az EP-választások előtti újraszavazáson majd az Európai Tanács előtt is megáll és törvényre emelkedik – kötelező lesz például feltüntetni a mesterséges és manipulált tartalmakat. A jogszabályt megszegő vállalatok a jövőben akár 35 millió eurós (több mint 13 milliárd forintos) bírsággal is számolhatnak – írja a Kreatív. A tagállamokkal tavaly decemberben egyeztetett rendeletjavaslatot 523 szavazattal, 46 ellenszavazattal és 49 tartózkodás mellett fogadták el az EP-képviselők.

Az Európai Unió mesterséges intelligenciáról szóló törvénye az AI-re vonatkozó első átfogó jogi keret a világon, szóval nagyon úttörő dologhoz van szerencséd. Az új szabályok célja, hogy Európában és azon túl is előmozdítsák a megbízható mesterséges intelligenciát azáltal, hogy biztosítják: a mesterséges intelligencia rendszerek tiszteletben tartják az alapvető jogokat, a biztonságot és az etikai elveket, valamint kezelik a rendkívül hatékony és hatásos AI-modellek kockázatait.

Az Európai Tanács azt írja, a mesterséges intelligenciáról szóló jogszabály a megbízható mesterséges intelligencia fejlesztését támogató, szélesebb körű szakpolitikai intézkedéscsomag részét képezi. Ez magában foglalja a mesterséges intelligenciával kapcsolatos innovációs csomagot és a mesterséges intelligenciára vonatkozó összehangolt tervet is. Az intézkedések együttesen garantálják az emberek és a vállalkozások biztonságát, illetve alapvető jogait a mesterséges intelligenciával kapcsolatban. Emellett Unió-szerte erősíteni fogják a mesterséges intelligencia elterjedését, a beruházásokat és az innovációt. A szabályok funkciója az, hogy

Forrás: Európai Tanács

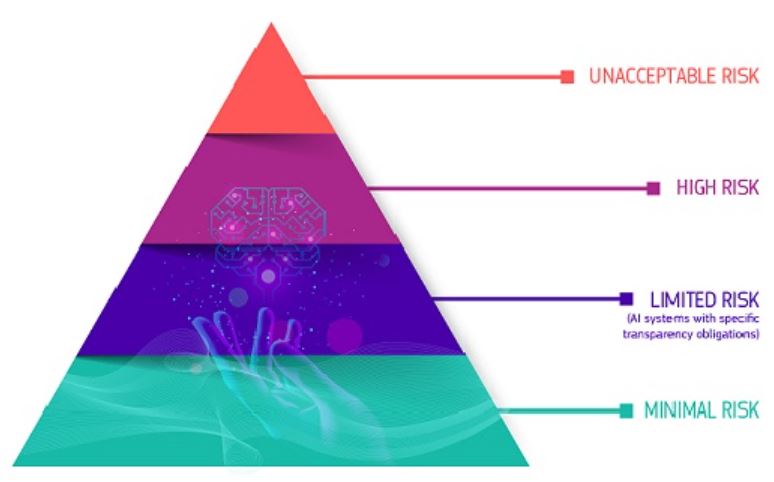

A magas, korlátozott, elfogadható és minimális kockázatú AI-k besorolása elég egyértelmű helyzetet teremthet, de a falhasználásuk konkrét esetei között érdemes kiemelni a gépi érzelemfelismerő rendszerek tiltását olyan közösségi terekben, amilyen például egy iskola vagy egy munkahely. Az alapjogokat sértő mesterséges intelligencia aalkalmazások ugyancsak tiltottakká válnak, köztük azok, amelyek érzékeny adatokon alapuló kategorizálással, vagy nyilvános adatbázisokból elérhető információk felhasználásával dolgoznak.

Hangsúlyosan nem lehet majd a gyakorlatban használni emberek sebezhetőségének kihasználásra irányuló és emberi viselkedés befolyásolására alkalmas AI-t, és ez utóbbi kapcsán érdemes kiemelni az egyik legtöbb usert érintő korlátozást is: kötelező lesz a deepfake tartalmak egyértelmű jelölése azzal, hogy az adott képet vagy videót AI-technológia használatával hozták létre.

Így képzeli el a mesterséges intelligencia Budapestet 50 év múlva